In het rechtenonderwijs aan de universiteit heeft een uiterst problematisch nieuw fenomeen zijn intrede gedaan. Studenten gebruiken het in groten getale; promovendi en academici doen dat steeds vaker. De NWO, die onderzoeksbeurzen verdeelt, staat het gebruik ervan bij aanvragen „op verantwoordelijke wijze” toe. Mogelijk komen er binnenkort nakijkhulpjes die ervan gebruik maken.

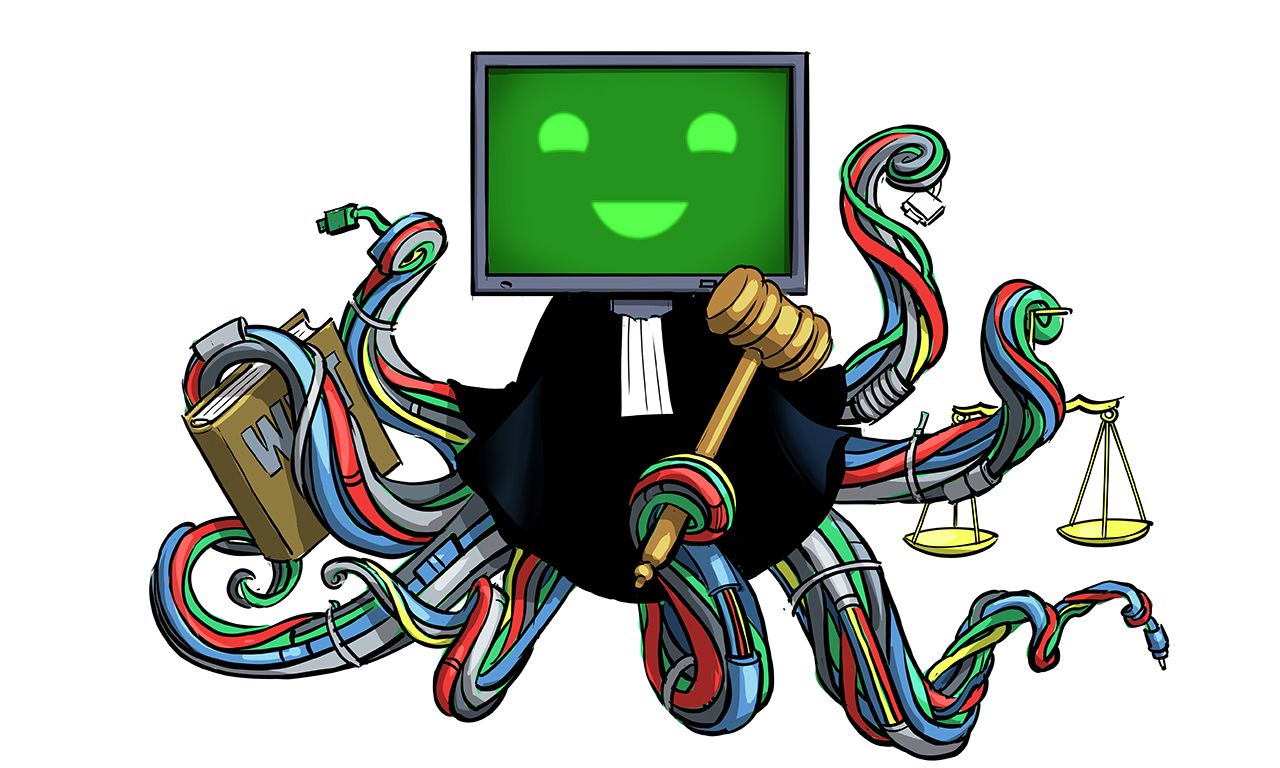

We hebben het natuurlijk over ChatGPT en andere vormen van generatieve AI. Dit steeds verder oprukkende gebruik van AI aan rechtenfaculteiten is bedreigend voor de democratische rechtsstaat, die in Nederland en daarbuiten toch al onder druk staat. Hoewel de discussie rond het gebruik van AI op de universiteit soms complex kan zijn, is dit ons duidelijke pleidooi: verban AI van rechtenfaculteiten. Voor studenten én voor academici.

Nu is generatieve AI natuurlijk een verschijnsel dat ook buiten het rechtenonderwijs voor uitdagingen zorgt, bijvoorbeeld op basis- en middelbare scholen. Maar toch is het rechtenonderwijs op een aantal manieren een geval apart.

Ten eerste: recht is taal, in verregaande mate. Juristen moeten kunnen lezen, begrijpen, ontleden, interpreteren, uitleggen, beschrijven, optekenen, beargumenteren, pleiten, en rechtspreken. Een machine die belooft dit werk uit handen te nemen, is natuurlijk heel verleidelijk. De meest gebruikte generatieve AI aan rechtenfaculteiten zijn dan ook taalmodellen.

Zelf nadenken

Maar juristen moeten dit zélf kunnen. Het schrijven van papers, essays en scripties tijdens de rechtenstudie dient ertoe om de studenten zelf te laten nadenken, en om hen, al onderzoekende en schrijvende, argumentatie te laten ontwikkelen. Op die manier leren zij wat de democratisch-rechtsstatelijke regels zijn, hoe ze met elkaar samenhangen, hoe ze werken, hoe ze gebruikt kunnen worden om maatschappelijke problemen op te lossen en hoe ze kunnen worden verbeterd.

Dat is niet eenvoudig. Wezenlijk begrip van een rechtssysteem kost in de regel minstens een paar jaar aan gespecialiseerd onderwijs. Dat begrip komt niet wanneer je het studeren uitbesteedt aan AI. Sterker nog, AI bedreigt het fundament onder een studie én ambacht: zelf iets leren, zelf fouten maken, een eigen stijl ontwikkelen.

Als studenten op de rechtenopleiding niet meer leren hoe zij zich in taal moeten uitdrukken, dan creëert dat ten tweede een maatschappelijk probleem. Rechtenfaculteiten leiden immers de toekomstige hoeders van de rechtsstaat op: rechters, officieren van justitie, wetgevingsjuristen, advocaten, notarissen, deurwaarders en griffiers.

En zeg nu eerlijk: wie zit er op te wachten om middels een AI-gegenereerd vonnis veroordeeld te worden door een rechter die amper iets zelf heeft gelezen en geschreven tijdens de rechtenstudie, na tevergeefs verdedigd te zijn door een advocaat die ook amper iets zelf heeft gelezen en geschreven?

Maar is generatieve AI niet veel beter in het creëren van een overtuigende tekst dan veel van de rechtenstudenten? Nou, nee. De taalmodellen doen namelijk niet heel veel meer dan gokken welk woord op het andere zou moeten volgen. Dat lijkt soms echt en diepzinnig denkwerk, maar is dat helemaal niet.

Het is ook niet efficiënt. AI-gebruik leidt, zeker bij het genereren van tekst, meestal niet tot tijdwinst, maar tot tijdverspilling. Voor de nakijkende docent, die bizarre teksten voorgeschoteld krijgt. Maar evengoed voor de studenten en academici die alle gegenereerde tekst alsnog moeten nalopen en controleren. Want hoewel sommige zinnen indrukwekkend zijn, klopt er nog vaak genoeg weinig tot niets van. En dat laatste is niet snel duidelijk; AI fabuleert er schaamteloos en zelfverzekerd op los. Daar doorheen te kunnen prikken, vereist voldoende kennis en een goede taalvaardigheid.

Behandel AI niet als voldongen feit dat we nu eenmaal ‘moeten’ gebruiken

Geletterdheid is trouwens ook los van het juridische vak heel belangrijk voor de democratische rechtsstaat. Denken is taal, en taal is denken. Autocraten hebben nooit veel opgehad met een bevolking die al te vrijelijk, genuanceerd en diep kan nadenken. Het versimpelen van taal, zoals in Orwells 1984, of het zonder goede democratisch-rechtsstatelijke reden verbieden van bepaalde taal, zoals door bijvoorbeeld Trump en Xi, doen niet voor niets de alarmbellen rinkelen.

Wat we in dat kader ook niet moeten vergeten is dat deze woord-raadmachines, en hun algoritmische instellingen, veelal in handen zijn van Big Tech, dat zoals bekend goede banden heeft met autocratische politici en regeringen. Veel Big Tech-kopstukken vinden dat democratie en rechtsstaat ‘ouderwetse software’ zijn, en zien meer in een techno-monarchie of techno-feodalisme. Daarom verdient ook het Big Tech-product generatieve AI gezond wantrouwen.

Daar komt nog bij: dat AI het vaak mis heeft, maar wel heel zelfverzekerd overkomt, past naadloos in de modus operandi van autocraten. Het is in hun belang dat de waarheid vervaagt en het maatschappelijk wantrouwen groeit. De Amerikaanse historicus Timothy Snyder (nu in zelfgekozen ballingschap in Canada) schreef in zijn boek Over tirannie (2017) twintig lessen op voor de omgang met autocratische dreiging. De eerste: gehoorzaam niet bij voorbaat.

Dit geldt ook voor de omgang van rechtenfaculteiten met dit nieuwste Big Tech-product. We hebben het niet nodig, en het is bovendien schadelijk voor het juridische ambacht. Waarom gaan we er dan toch mee ‘aan de slag’? Waarom kunnen we niet eerst eens tien jaar wachten?

Er zijn nog wel meer zaken die het gebruik van AI op rechtenfaculteiten (en elders in de academie) problematisch maken. Zo bestaat generatieve AI bij de gratie van grootschalige diefstal van intellectueel eigendom: de data waarop de modellen getraind zijn. Waarom zou dat nota bene aan rechtenfaculteiten getolereerd worden? Daarnaast rijst de vraag hoe we bij het gebruik van AI ooit nog het eigen denk- en schrijfwerk kunnen onderscheiden van plagiaat – een academische doodzonde.

Aalgladde machine

We kunnen onze democratie dus niet overleveren aan een aalgladde woord-raadmachine – zelfs wanneer die ook weleens correct raadt. We moeten haar zo veel mogelijk in eigen, menselijke hand houden.

Ja, het zou kunnen dat generatieve AI in bepaalde gevallen wél wezenlijk toegevoegde waarde heeft. Maar dat zou dan pas kunnen nadat een (inter)facultaire AI-commissie het gebruik streng heeft getoetst, rekening houdend met de bovenstaande factoren.

Wat AI betreft, kunnen rechtenfaculteiten een voorbeeld nemen aan het milieurecht. Daar is het voorzorgsbeginsel leidend. Simpel gezegd: bij een bouwproject in een kwetsbaar kustgebied moet eerst aangetoond worden dat het geen schade zal opleveren. De bewijslast ligt dus bij de projectontwikkelaar en niet bij natuurbeschermingsorganisaties. In dubio pro natura, zoals dat in vaktermen heet.

Rechtenfaculteiten moeten zo’n voorzorgsbeginsel ook instellen ten aanzien van AI – in dubio contra machina. Verban ChatGPT en consorten van rechtenfaculteiten. Verbied gebruik van AI voor het genereren en structureren van teksten, maar ook als zoekmachine (die bestonden al), spellingschecker (die ook), en ‘discussie-maatje’ (daar zijn medestudenten en docenten voor). Sta niet toe dat studenten en docenten het ‘verstandig gebruiken’, ‘echt wel onder controle kunnen houden’, of ‘enkel gebruiken om een beetje te kijken hoe ik mijn alinea’s beter kan indelen, verder niks!’.

BioStabil 2000

Behandel AI al helemáál niet als voldongen feit dat we nu eenmaal ‘moeten’ gebruiken. En wees beducht op argumenten over ‘tijdwinst’, ‘efficiëntie’ en de waarschijnlijk niet lang daarna volgende bezuinigingen op academisch personeel. Weersta de verleiding de ‘student van de toekomst op te leiden’. Weersta ook de neiging om dit fonkelnieuwe ‘gereedschap’ te gebruiken ‘omdat het er nu eenmaal is’ of omdat studenten en academici ‘het nu eenmaal gebruiken’. De waterstofbom, de PFAS-pan, en de BioStabil 2000 bestaan ook – maar niet alle nieuwe technologie hoeft gebruikt te worden, en al helemaal niet in iedere context.

Natuurlijk roept zo’n verbod onmiddellijk vragen op over handhaafbaarheid, maar die vragen zijn er nu ook en handhaving is mogelijk juist eenvoudiger wanneer de lijn duidelijk is.

Laten we de democratische rechtsstaat niet uit handen geven aan in zielloze in-flight-magazine-taal geformuleerde onzin, obscure algoritmes, en met autocraten heulende Big Tech-magnaten. Houd hem in handen van mensen die daadwerkelijk hun best moeten doen, die daadwerkelijk iets kunnen, die daadwerkelijk iets weten, die het belang van taal voelen, die al worstelend en zelf nadenkend zinnige gedachten leren vormen en articuleren, en die fouten durven te maken en daarvan willen leren.

Lees ook

Deze boeken werpen een ontluisterend licht op de toekomstfantasieën van de tech-miljardairs