IBM-onderzoekers hebben een computerchip gemaakt die geïnspireerd is op het menselijk brein. Hiermee kunnen algoritmes voor kunstmatige intelligentie veel energiezuiniger worden uitgevoerd dan op de klassieke chips.

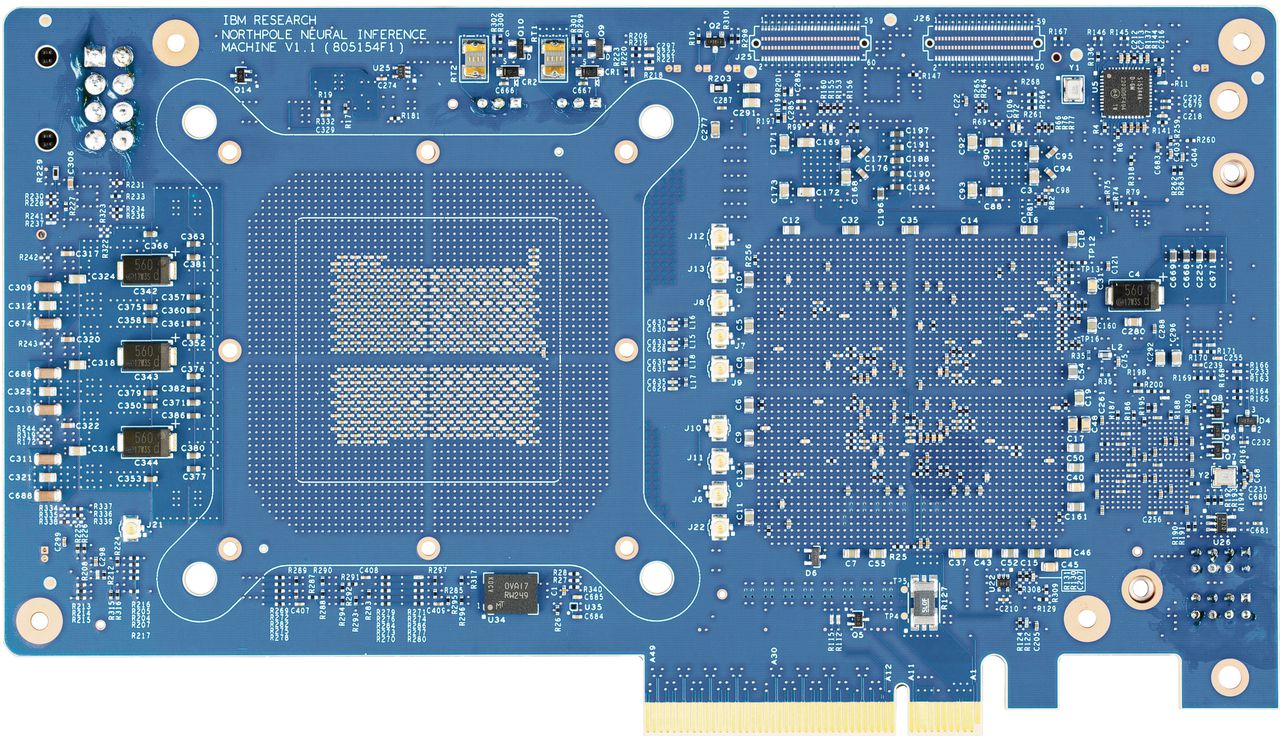

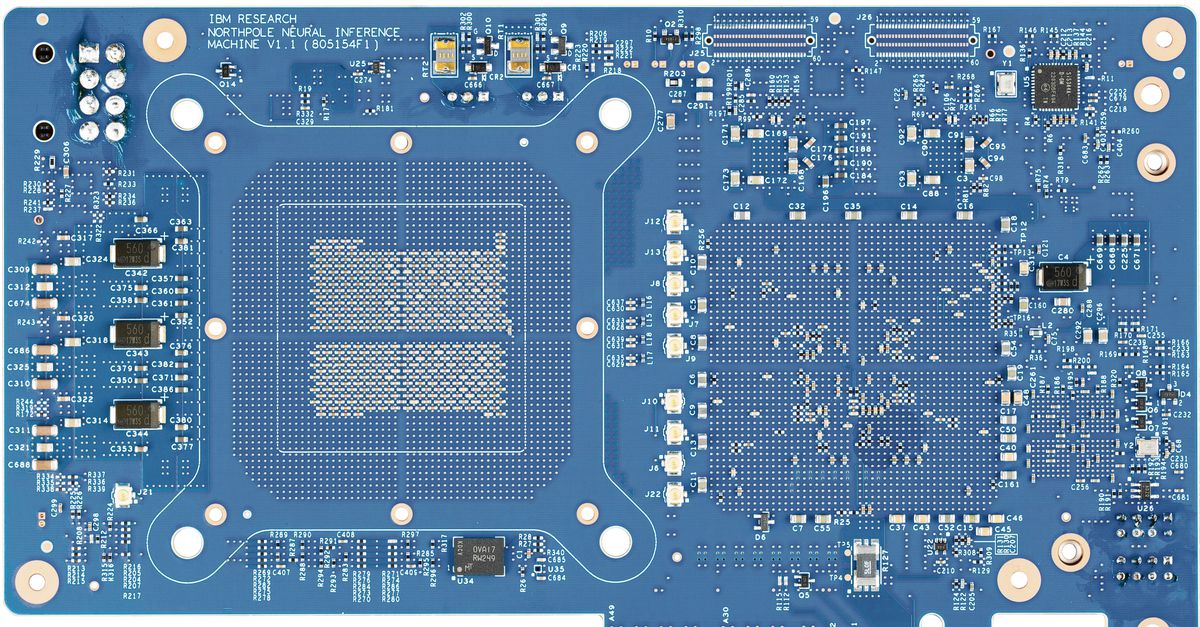

Normaal gesproken zitten de microprocessor – de CPU (central processing unit), het deel van de chip dat verantwoordelijk is voor het uitvoeren van computercode – en het geheugen apart. In de nieuwe NorthPole-chip van IBM zijn het geheugen en de processors door elkaar heen geplaatst. Dit ontwerp werd donderdag in het wetenschappelijk tijdschrift Science gepublicerd.

De klassieke computerchip is minder geschikt voor kunstmatige intelligentie omdat hij voor het draaien van dit soort toepassingen relatief veel energie nodig heeft. Dat is een probleem omdat AI sterk in opmars is. Vragen stellen aan ChatGTP, nieuwe muziek ontdekken op Spotify en gezichtsherkenning gebruiken – het maakt allemaal gebruik van kunstmatige intelligentie.

Architectuur

Algoritmes voor kunstmatige intelligentie werken met modellen waarin veel variabelen een rol spelen. Hierdoor moet er bij gebruik van zo’n algoritme veel informatie tussentijds worden opgeslagen. Dat betekent dat in een normale chip, waar het geheugen en de processor van elkaar gescheiden zijn, een constante stroom van data heen en weer loopt die veel energie kost.

Dit wordt ook wel de ‘Von Neumann bottleneck’ genoemd, omdat John von Neumann in 1945 deze architectuur voor een computer beschreef waarbij geheugen en verwerking los van elkaar staan.

Yoeri van de Burgt doet aan de TU Eindhoven onderzoek naar chips die op het menselijk brein geïnspireerd zijn en hopelijk minder energie gaan verbruiken. „Binnen nu en tien à twintig jaar gaat het energieverbruik van kunstmatige intelligentie echt een probleem worden. Je ziet het al, zeker nu iedereen met ChatGTP aan het spelen is. Datacenters gebruiken al evenveel energie als sommige landen.”

Er wordt voor kunstmatige intelligentie op dit moment veel gebruik gemaakt van GPU’s (graphic processing units), die meerdere berekeningen tegelijk kunnen maken. Hier werken AI-algoritmes al beter op dan op de klassieke CPU’s. Nvidia is de grootste producent van GPU-chips en profiteert van de grote vraag naar chips die geschikt zijn voor kunstmatige intelligentie. Toch zijn deze GPU’s nog niet ideaal, omdat een groot deel van het geheugen nog steeds gescheiden is van de processors.

600 foto’s per joule

In het menselijk brein wordt informatie opgeslagen bij het maken van verbindingen tussen zenuwcellen. Dit gebeurt overal, verspreid over de hersens. De NorthPole-chip van de IBM-onderzoekers is hierop geïnspireerd en heeft het geheugen verdeeld over de chip. In plaats van dat er op één centrale plek in de chip geheugen ligt en er ook gebruik gemaakt moet worden van geheugen dat niet op de chip ligt, is de NorthPole-chip opgebouwd uit verschillende processors waarnaast geheugenopslag ligt. Doordat informatieverwerking en opslag dicht bij elkaar plaatsvindt en er geen gebruikt hoeft te worden gemaakt van off-chip memory, vermijdt de NorthPole grotendeels de Von Neumann bottleneck.

Hierdoor verbruikt deze nieuwe chip veel minder energie dan een GPU voor taken zoals het herkennen van objecten in foto’s. De onderzoekers stellen in het Science-artikel dat de NorthPole-chip wel 600 foto’s per joule kan verwerken, in vergelijking met 200 foto’s per joule bij een GPU.

De chip is minder geschikt voor het trainen van kunstmatige intelligentie. De NorthPole is specifiek gemaakt voor de uitvoer van specifieke taken als het AI-model al is getraind.

Van der Wiel verwacht dat de NorthPole-chip op de korte termijn gebruikt gaat worden. De chip wordt van silicium gemaakt, het materiaal waar ook de klassieke chips van gemaakt worden en dat op grote schaal verkrijgbaar is.

Hij denkt dat siliciumchips op de lange termijn niet de toekomst hebben: „Voor echt energiezuinige computers moeten we kijken wat we met andere materialen kunnen doen. Zodat we chips kunnen gaan bouwen die zelflerend zijn, net als het brein. Die zullen nog energiezuiniger zijn.”